互聯網域名根服務器是域名系統(DNS)的核心組成部分,負責存儲全球頂級域名(如.com、.org、.cn等)的根區文件,并響應來自全球遞歸DNS服務器的查詢請求。這些服務器的設置和運行對互聯網的穩定性和安全性至關重要。本文將針對根服務器的設置、運行機構及注冊管理機構的申請過程,解答一些常見問題。

1. 什么是互聯網域名根服務器?

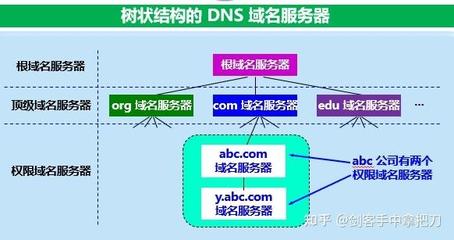

互聯網域名根服務器是DNS層次結構中的最高級別服務器,全球共有13個根服務器集群(由字母A到M標識),分布在不同國家和地區。它們不直接解析具體域名,而是提供頂級域名服務器的地址,指引查詢流向正確的權威服務器。

2. 根服務器的設置和運行機構有哪些?

根服務器的運行由多個機構負責,包括非營利組織、政府和商業實體。例如,VeriSign公司負責運營A和J根服務器,ICANN(互聯網名稱與數字地址分配機構)管理部分根服務器,而其他機構如美國航天局(NASA)也參與運行。這些機構需遵循嚴格的國際協議和標準,確保服務器的冗余性和安全性。

3. 如何申請成為根服務器運行機構或注冊管理機構?

申請過程通常涉及以下步驟:機構需向ICANN或其他相關國際組織提交提案,證明其具備足夠的技術能力、財務資源和運營經驗。必須通過安全審核,確保能抵御網絡攻擊。需獲得所在國家或地區的政策支持,并遵守全球互聯網治理規則。常見問題包括:申請材料不完整、技術標準不達標或國際協調困難。建議申請者提前咨詢專業機構,并參與相關論壇以了解最新要求。

4. 根服務器運行中的常見挑戰是什么?

運行根服務器面臨的主要挑戰包括:DDoS攻擊、物理安全風險、以及全球網絡延遲問題。運行機構必須部署多層防護措施,如Anycast技術分散流量,并與全球組織合作監控威脅。政策變化和國際關系也可能影響服務器的穩定運行。

5. 未來發展趨勢如何?

隨著互聯網的擴展,根服務器系統正逐步采用新技術,如DNSSEC(域名系統安全擴展)增強安全性,以及分布式架構提高韌性。ICANN和相關機構持續推動多利益相關方模式,鼓勵更多地區參與運行,以促進全球互聯網的公平性和可靠性。

互聯網域名根服務器的設置和運行是一個復雜但關鍵的過程,涉及技術、政策和國際合作。通過理解這些常見問題,相關機構可以更好地準備申請和運營工作,為互聯網的健康發展貢獻力量。